Hiyerarşik kümeleme - Hierarchical clustering

| Bir dizinin parçası |

| Makine öğrenme ve veri madenciliği |

|---|

Makine öğrenimi mekanları |

İçinde veri madenciliği ve İstatistik, hiyerarşik kümeleme (olarak da adlandırılır hiyerarşik küme analizi veya HCA) bir yöntemdir küme analizi inşa etmeye çalışan hiyerarşi kümelerin. Hiyerarşik kümeleme stratejileri genellikle iki türe ayrılır:[1]

- Aglomeratif: Bu bir "altüst "yaklaşım: her gözlem kendi kümesinde başlar ve hiyerarşide yukarı çıktıkça küme çiftleri birleştirilir.

- Bölücü: Bu bir "yukarıdan aşağıya "yaklaşım: tüm gözlemler tek bir kümede başlar ve bölmeler, hiyerarşide aşağı doğru ilerlerken yinelemeli olarak gerçekleştirilir.

Genel olarak, birleşmeler ve bölünmeler bir açgözlü tavır. Hiyerarşik kümelemenin sonuçları[2] genellikle bir dendrogram.

İçin standart algoritma hiyerarşik aglomeratif kümeleme (HAC) bir zaman karmaşıklığı nın-nin ve gerektirir bellek, bu da orta veri kümeleri için bile çok yavaş yapar. Bununla birlikte, bazı özel durumlar için, optimal verimli aglomeratif yöntemler (karmaşıklık ) bilinmektedir: SLINK[3] için tek bağlantı ve CLINK[4] için tam bağlantı kümeleme. Birlikte yığın, genel durumun çalışma süresi azaltılabilir , yukarıda belirtilen sınırda bir gelişme , bellek gereksinimlerini daha da artırmak pahasına. Çoğu durumda, bu yaklaşımın bellek ek yükleri, onu pratik olarak kullanılabilir hale getirmek için çok büyüktür.

Özel tek bağlantı durumu dışında, algoritmalardan hiçbiri (içinde kapsamlı arama hariç) ) optimum çözümü bulacağı garanti edilebilir.

Kapsamlı bir aramayla bölücü kümeleme , ancak k-araçları gibi bölmeleri seçmek için daha hızlı buluşsal yöntemler kullanmak yaygındır.

Küme farklılığı

Hangi kümelerin birleştirilmesi gerektiğine (kümelenme için) veya bir kümenin nerede bölünmesi gerektiğine (bölücü için) karar vermek için, gözlem kümeleri arasında bir farklılık ölçüsü gereklidir. Çoğu hiyerarşik kümeleme yönteminde bu, uygun bir metrik (Bir ölçüsü mesafe gözlem çiftleri arasında) ve kümelerdeki gözlemlerin ikili uzaklıklarının bir fonksiyonu olarak kümelerin farklılığını belirten bir bağlantı kriteri.

Metrik

Bazı öğeler, bir metrikte diğerine göre nispeten birbirine daha yakın olabileceğinden, uygun bir metriğin seçimi, kümelerin şeklini etkileyecektir. Örneğin, iki boyutta, Manhattan uzaklık ölçüsü altında, başlangıç noktası (0,0) ve (.5, .5) arasındaki mesafe, başlangıç noktası ile (0, 1) arasındaki mesafe ile aynıdır. Öklid uzaklık ölçüsü ikincisi kesinlikle daha büyüktür.

Hiyerarşik kümeleme için yaygın olarak kullanılan bazı metrikler şunlardır:[5]

| İsimler | Formül |

|---|---|

| Öklid mesafesi | |

| Kare Öklid mesafesi | |

| Manhattan mesafesi | |

| Maksimum mesafe | |

| Mahalanobis mesafesi | nerede S ... Kovaryans matrisi |

Metin veya diğer sayısal olmayan veriler için, Hamming mesafesi veya Levenshtein mesafesi sıklıkla kullanılır.

Sağlık psikolojisi araştırmalarında küme analizinin bir incelemesi, o araştırma alanında yayınlanan çalışmalarda en yaygın mesafe ölçüsünün Öklid mesafesi veya kare Öklid mesafesi olduğunu buldu.[kaynak belirtilmeli ]

Bağlantı kriterleri

Bağlantı kriteri, gözlemler arasındaki ikili mesafelerin bir fonksiyonu olarak gözlem setleri arasındaki mesafeyi belirler.

İki gözlem grubu arasında yaygın olarak kullanılan bazı bağlantı kriterleri Bir ve B şunlardır:[6][7]

| İsimler | Formül |

|---|---|

| Maksimum veya tam bağlantı kümeleme | |

| Minimum veya tek bağlantılı kümeleme | |

| Ağırlıksız ortalama bağlantı kümelemesi (veya UPGMA ) | |

| Ağırlıklı ortalama bağlantı kümelemesi (veya WPGMA ) | |

| Centroid bağlantı kümeleme veya UPGMC | nerede ve kümelerin ağırlık merkezleridir s ve t, sırasıyla. |

| Minimum enerji kümelenmesi |

nerede d seçilen ölçüdür. Diğer bağlantı kriterleri şunları içerir:

- Tüm küme içi varyansın toplamı.

- Birleştirilmekte olan küme için varyanstaki artış (Ward kriteri ).[8]

- Aday kümelerin aynı dağıtım işlevinden (V-bağlantısı) ortaya çıkma olasılığı.

- Bir k-en yakın komşu grafiğindeki derece ve dış derecenin çarpımı (grafik derece bağlantısı).[9]

- İki kümeyi birleştirdikten sonra bazı küme tanımlayıcısının artışı (yani, bir kümenin kalitesini ölçmek için tanımlanan bir miktar).[10][11][12]

Tartışma

Hiyerarşik kümeleme, herhangi bir geçerli mesafe ölçümünün kullanılabilmesi gibi belirgin bir avantaja sahiptir. Aslında, gözlemlerin kendisi gerekli değildir: kullanılan tek şey bir mesafeler matrisidir.

Aglomeratif kümeleme örneği

Örneğin, bu verilerin kümeleneceğini ve Öklid mesafesi ... mesafe ölçüsü.

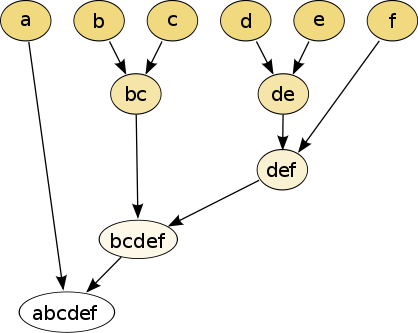

Hiyerarşik kümeleme dendrogram şöyle olurdu:

Ağacın belirli bir yükseklikte kesilmesi, seçilen bir hassasiyette bir bölümleme kümeleme sağlayacaktır. Bu örnekte, sayfanın ikinci satırından (üstten) sonra kesmek dendrogram kümeler oluşturacaktır {a} {b c} {d e} {f}. Üçüncü satırdan sonra kesmek, daha küçük sayıda ancak daha büyük kümelere sahip daha kaba bir kümeleme olan {a} {b c} {d e f} kümelerini verecektir.

Bu yöntem, kümeleri aşamalı olarak birleştirerek bireysel öğelerden hiyerarşiyi oluşturur. Örneğimizde, {a} {b} {c} {d} {e} ve {f} altı öğemiz var. İlk adım, bir kümede hangi öğelerin birleştirileceğini belirlemektir. Genellikle, seçilen mesafeye göre en yakın iki unsuru almak isteriz.

İsteğe bağlı olarak, bir de bir mesafe matrisi bu aşamada, numaranın bulunduğu ben-atmak j-th sütun, arasındaki mesafedir ben-th ve j-nci öğeler. Ardından, kümeleme ilerledikçe, kümeler birleştirilirken ve mesafeler güncellenirken satırlar ve sütunlar birleştirilir. Bu, bu tür kümelemeyi uygulamanın yaygın bir yoludur ve kümeler arasındaki mesafeleri önbelleğe alma avantajına sahiptir. Basit bir aglomeratif kümeleme algoritması, tek bağlantılı kümeleme sayfa; farklı bağlantı türlerine kolayca uyarlanabilir (aşağıya bakın).

En yakın iki öğeyi birleştirdiğimizi varsayalım b ve c, şimdi aşağıdaki kümelere sahibiz {a}, {b, c}, {d}, {e} ve {f} ve onları daha da birleştirmek istiyor. Bunu yapmak için, {a} ve {b c} arasındaki mesafeyi almamız ve bu nedenle iki küme arasındaki mesafeyi tanımlamamız gerekir. ve aşağıdakilerden biridir:

- Her kümenin elemanları arasındaki maksimum mesafe (aynı zamanda tam bağlantı kümeleme ):

- Her kümenin elemanları arasındaki minimum mesafe (aynı zamanda tek bağlantılı kümeleme ):

- Her kümenin elemanları arasındaki ortalama mesafe (aynı zamanda ortalama bağlantı kümelenmesi olarak da adlandırılır, örn. UPGMA ):

- Tüm küme içi varyansın toplamı.

- Birleştirilmekte olan küme için varyanstaki artış (Ward yöntemi[8])

- Aday kümelerin aynı dağıtım işlevinden (V-bağlantısı) ortaya çıkma olasılığı.

Bağlı minimum mesafeler durumunda, bir çift rastgele seçilir, böylece yapısal olarak farklı birkaç dendrogram oluşturabilir. Alternatif olarak, tüm bağlı çiftler, benzersiz bir dendrogram oluşturarak aynı anda birleştirilebilir.[13]

Yeterince az sayıda küme (sayı kriteri) olduğunda her zaman kümelenmeyi durdurmaya karar verilebilir. Bazı bağlantılar, kümeler arasında önceki kümelenmeden daha büyük bir mesafede kümelenmenin meydana gelmesini garanti edebilir ve daha sonra kümeler birleştirilemeyecek kadar uzak olduğunda kümelenme durdurulabilir (mesafe kriteri). Bununla birlikte, bu, örneğin, sözde ters çevirmelerin bulunduğu ağırlık merkezi bağlantısı durumunda geçerli değildir.[14] (inversiyonlar, ultrametriklikten sapmalar) meydana gelebilir.

Bölücü kümeleme

Bölücü kümelemenin temel ilkesi DIANA (DIvisive ANAlysis Clustering) algoritması olarak yayınlandı.[15] Başlangıçta tüm veriler aynı kümede bulunur ve en büyük küme, her nesne ayrı olana kadar bölünür. her kümeyi bölmenin yolları, buluşsal yöntemlere ihtiyaç vardır. DIANA, maksimum ortalama farklılığa sahip nesneyi seçer ve ardından tüm nesneleri, geri kalanından daha yeni kümeye benzer olan bu kümeye taşır.

Yazılım

Açık kaynak uygulamaları

- ALGLIB O (n²) bellek ve O (n³) çalışma süresi ile C ++ ve C # 'da çeşitli hiyerarşik kümeleme algoritmaları (tek bağlantı, tam bağlantı, Ward) uygular.

- ELKI birden fazla hiyerarşik kümeleme algoritması, çeşitli bağlantı stratejileri içerir ve ayrıca verimli SLINK içerir,[3] CLINK[4] ve Anderberg algoritmaları, dendrogramlardan esnek küme çıkarma ve diğer çeşitli küme analizi algoritmalar.

- Oktav, GNU benzer MATLAB "bağlantı" işlevinde hiyerarşik kümeleme uygular.

- turuncu bir veri madenciliği yazılım paketi, etkileşimli dendrogram görselleştirme ile hiyerarşik kümeleme içerir.

- R hiyerarşik kümeleme için işlevler sağlayan birçok pakete sahiptir.

- SciPy Etkili SLINK algoritması dahil Python'da hiyerarşik kümeleme uygular.

- scikit-öğrenmek ayrıca Python'da hiyerarşik kümeleme uygular.

- Weka hiyerarşik küme analizini içerir.

Ticari uygulamalar

- MATLAB hiyerarşik küme analizini içerir.

- SAS PROC CLUSTER'da hiyerarşik küme analizini içerir.

- Mathematica Hiyerarşik Kümeleme Paketi içerir.

- NCSS hiyerarşik küme analizini içerir.

- SPSS hiyerarşik küme analizini içerir.

- Qlucore Omics Explorer, hiyerarşik küme analizi içerir.

- Stata hiyerarşik küme analizini içerir.

- CrimeStat bir Coğrafi Bilgi Sistemi için bir grafik çıktısı olan en yakın komşu hiyerarşik küme algoritmasını içerir.

Ayrıca bakınız

- İkili uzay bölümleme

- Sınırlayıcı birim hiyerarşisi

- Kahverengi kümeleme

- Cladistics

- Küme analizi

- Hesaplamalı filogenetik

- CURE veri kümeleme algoritması

- Dasgupta'nın amacı

- Dendrogram

- Bir veri kümesindeki küme sayısının belirlenmesi

- Ağların hiyerarşik kümelenmesi

- Yerellik duyarlı hashing

- En yakın komşu araması

- En yakın komşu zincir algoritması

- Sayısal taksonomi

- OPTICS algoritması

- İstatistiksel mesafe

- Kalıcı homoloji

Referanslar

- ^ Rokach, Lior ve Oded Maimon. "Kümeleme yöntemleri." Veri madenciliği ve bilgi keşfi el kitabı. Springer US, 2005. 321-352.

- ^ Frank Nielsen (2016). "Bölüm 8: Hiyerarşik Kümeleme". Veri Bilimi için MPI ile HPC'ye Giriş. Springer.

- ^ a b R. Sibson (1973). "SLINK: tek bağlantılı küme yöntemi için optimum düzeyde verimli bir algoritma" (PDF). Bilgisayar Dergisi. İngiliz Bilgisayar Topluluğu. 16 (1): 30–34. doi:10.1093 / comjnl / 16.1.30.

- ^ a b D. Defays (1977). "Tam bağlantı yöntemi için verimli bir algoritma". Bilgisayar Dergisi. İngiliz Bilgisayar Topluluğu. 20 (4): 364–366. doi:10.1093 / comjnl / 20.4.364.

- ^ "DISTANCE Prosedürü: Yakınlık Önlemleri". SAS / STAT 9.2 Kullanıcı Kılavuzu. SAS Enstitüsü. Alındı 2009-04-26.

- ^ "CLUSTER Prosedürü: Kümeleme Yöntemleri". SAS / STAT 9.2 Kullanıcı Kılavuzu. SAS Enstitüsü. Alındı 2009-04-26.

- ^ Székely, G. J .; Rizzo, M.L. (2005). "Arası Ortak Mesafeler aracılığıyla hiyerarşik kümeleme: Ward'ın Minimum Varyans Yöntemini Genişletme". Journal of Classification. 22 (2): 151–183. doi:10.1007 / s00357-005-0012-9.

- ^ a b Ward, Joe H. (1963). "Hedef İşlevini Optimize Etmek İçin Hiyerarşik Gruplama". Amerikan İstatistik Derneği Dergisi. 58 (301): 236–244. doi:10.2307/2282967. JSTOR 2282967. BAY 0148188.

- ^ Zhang, Wei; Wang, Xiaogang; Zhao, Şarküteri; Tang Xiaoou (2012). Fitzgibbon, Andrew; Lazebnik, Svetlana; Perona, Pietro; Sato, Yoichi; Schmid, Cordelia (editörler). "Grafik Derecesi Bağlantısı: Yönlendirilmiş Grafik Üzerinde Aglomeratif Kümeleme". Bilgisayarla Görme - ECCV 2012. Bilgisayar Bilimlerinde Ders Notları. Springer Berlin Heidelberg. 7572: 428–441. arXiv:1208.5092. Bibcode:2012arXiv1208.5092Z. doi:10.1007/978-3-642-33718-5_31. ISBN 9783642337185. Ayrıca bakınız: https://github.com/waynezhanghk/gacluster

- ^ Zhang, vd. "Maksimum artımlı yol integrali aracılığıyla kümelenmeli kümeleme." Örüntü Tanıma (2013).

- ^ Zhao ve Tang. "Bir grafiğin zeta fonksiyonu aracılığıyla kümeleri döngüselleştirme." Sinirsel Bilgi İşleme Sistemlerindeki Gelişmeler. 2008.

- ^ Ma, vd. "Kayıplı veri kodlama ve sıkıştırma yoluyla çok değişkenli karma verilerin segmentasyonu." Örüntü Analizi ve Makine Zekası Üzerine IEEE İşlemleri, 29 (9) (2007): 1546-1562.

- ^ Fernández, Alberto; Gómez, Sergio (2008). "Çoklu Endrogramlar Kullanarak Aglomeratif Hiyerarşik Kümelemede Eşsizliği Çözme". Journal of Classification. 25 (1): 43–65. arXiv:cs / 0608049. doi:10.1007 / s00357-008-9004-x.

- ^ Legendre, S .; Legendre, L. (2003). Sayısal Ekoloji. Elsevier Science BV.

- ^ Kaufman, L. ve Roussew, P. J. (1990). Verilerde Grup Bulma - Kümeleme Analizine Giriş. Bir Wiley-Science Yayını John Wiley & Sons.

daha fazla okuma

- Kaufman, L .; Rousseeuw, P.J. (1990). Verilerde Grup Bulma: Küme Analizine Giriş (1 ed.). New York: John Wiley. ISBN 0-471-87876-6.

- Hastie, Trevor; Tibshirani, Robert; Friedman, Jerome (2009). "14.3.12 Hiyerarşik kümeleme". İstatistiksel Öğrenmenin Unsurları (2. baskı). New York: Springer. s. 520–528. ISBN 978-0-387-84857-0. Arşivlenen orijinal (PDF) 2009-11-10 tarihinde. Alındı 2009-10-20.